揭秘ChatGPT背后的深度学习技术

近年来,人工智能技术的飞速发展引发了各行各业的广泛关注,尤其是深度学习的突破性进展,使得像ChatGPT这样的语言模型成为可能。ChatGPT作为一款由OpenAI开发的强大自然语言处理工具,广泛应用于各个领域,包括智能客服、内容创作和编程辅助等。很多人对ChatGPT背后所依赖的深度学习技术了解甚少。本文将深入探讨ChatGPT的工作原理、核心技术以及如何通过现代深度学习模型实现其卓越的表现,帮助读者更好地理解这一技术的底层架构。与此我们还将介绍如何通过工具如DataFocus,辅助进行数据分析与深度学习模型的优化,提升人工智能系统的效能。

一、深度学习技术的基础

深度学习是机器学习的一个子领域,它通过模仿人脑神经元的结构和功能,使用多层的神经网络来处理数据。相较于传统的机器学习算法,深度学习能够自动从大量的数据中提取特征,而无需人工设计特征提取的方法。这一特性使得深度学习在图像识别、语音识别、自然语言处理等领域取得了突破性进展。

在深度学习中,神经网络的层数越多,模型的学习能力就越强。每一层神经网络都会通过加权连接与前一层交换信息,通过非线性激活函数进行转化和优化,最终使得模型能够理解和生成复杂的模式和数据结构。

二、ChatGPT的核心技术:Transformer

ChatGPT基于一种名为“Transformer”的深度学习架构。Transformer最早由Vaswani等人于2017年提出,并迅速成为自然语言处理(NLP)领域的革命性技术。与传统的RNN(递归神经网络)和LSTM(长短期记忆网络)相比,Transformer通过“自注意力机制”解决了长文本处理中的计算瓶颈问题,并极大提升了模型的训练效率和效果。

Transformer的核心思想是通过自注意力机制(Self-Attention)来捕捉词语之间的长程依赖关系。在传统的RNN中,序列中前面的信息对后续信息的影响会逐渐减弱,而在Transformer中,通过全局的注意力机制,模型可以在任意位置之间建立直接联系,解决了这个问题。

具体而言,Transformer模型通过将输入序列中的每个词语与其他所有词语进行关联计算,确定它们之间的关系,并据此调整输出。由于自注意力机制的并行计算特性,Transformer能在短时间内处理大量数据,大大提升了训练速度。

三、GPT模型的演化与发展

GPT(Generative Pre-trained Transformer)系列是基于Transformer架构的预训练语言模型,其核心思想是通过大规模的无监督学习预训练一个强大的语言理解模型,然后通过少量的有监督数据进行微调,使其具备执行具体任务的能力。

GPT模型的训练过程分为两个阶段:预训练和微调。GPT通过海量的文本数据进行无监督预训练,学习语言的基本结构、语法规则以及常识知识。然后,在微调阶段,模型通过特定任务的数据进行有监督学习,使得模型能够在特定应用场景中表现出色。

ChatGPT,作为GPT系列中的一员,采用了这一框架并经过大规模的优化和训练。通过在海量的语料库中训练,ChatGPT能够在各种对话场景下生成流畅、自然的语言回复,并表现出强大的上下文理解和推理能力。

四、ChatGPT的训练数据与模型优化

训练ChatGPT这类语言模型需要大量的高质量数据。为了确保模型的语言能力和知识储备,OpenAI使用了来自多种来源的大规模数据集,包括书籍、文章、论坛对话、网页内容等。这些数据经过清洗和筛选,去除了不相关或有害的信息,从而保证了模型生成内容的准确性和可靠性。

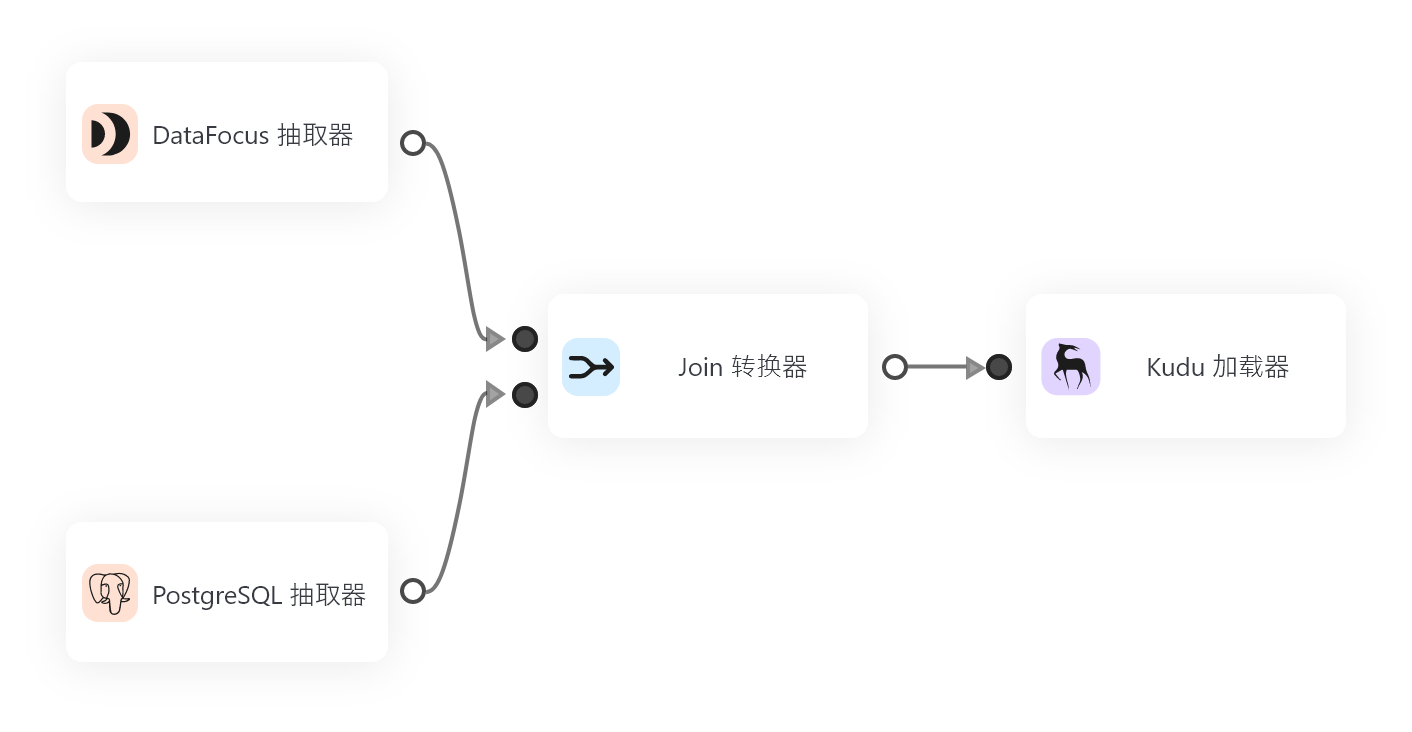

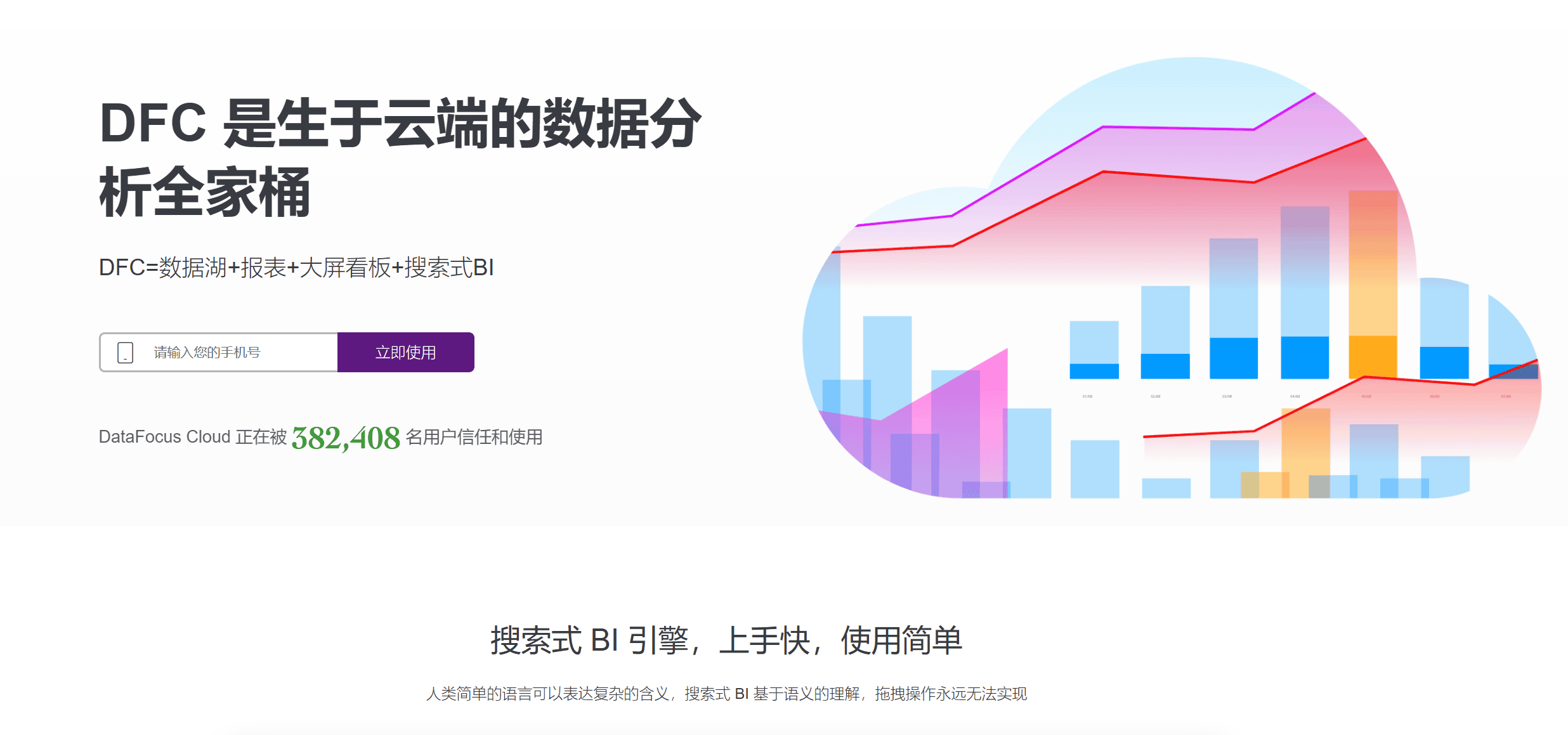

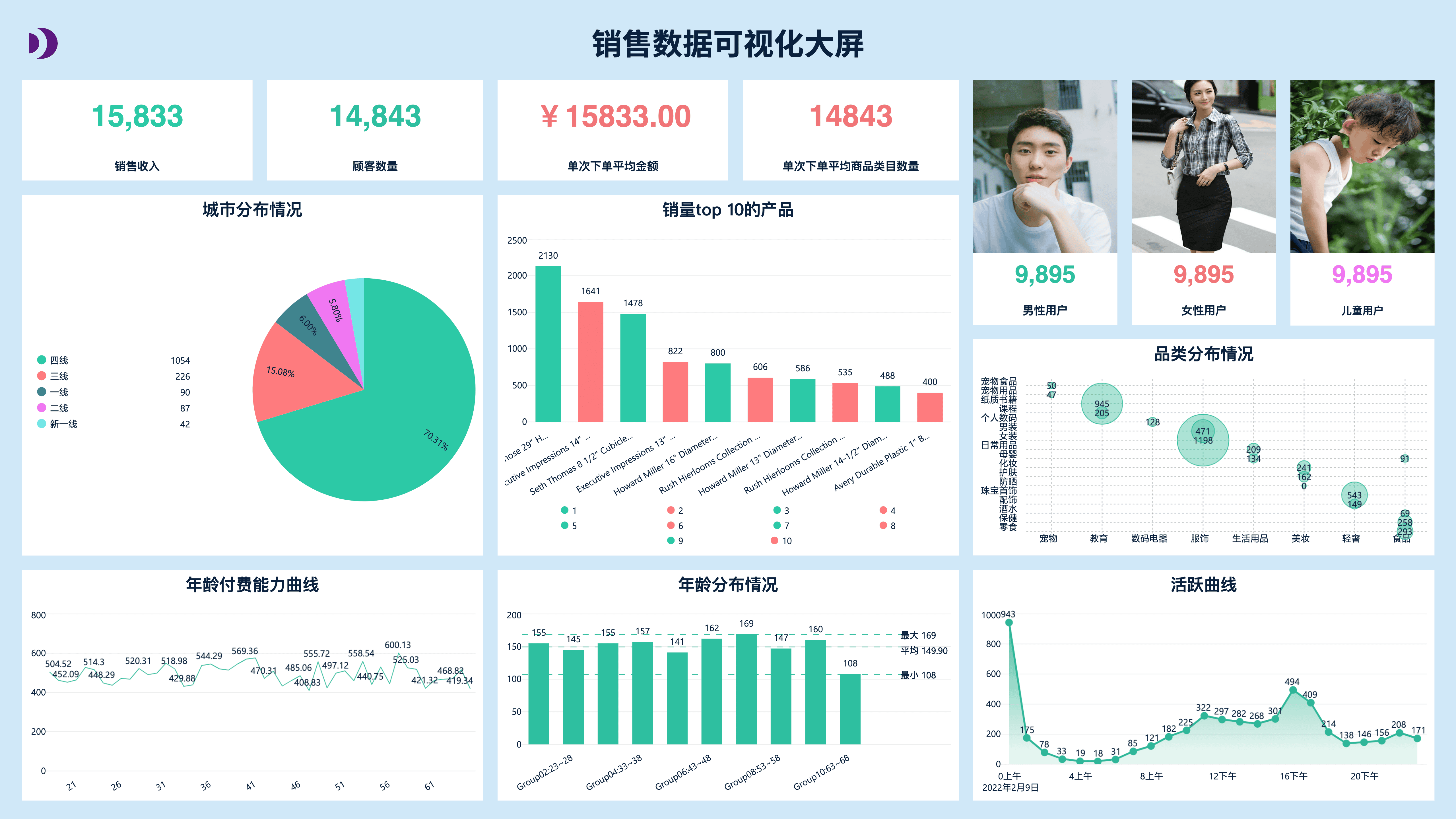

单纯依赖数据并不足以保证模型的优秀表现。为了让模型能够在各种复杂的对话场景中应对自如,还需要进行细致的优化。在这一过程中,像DataFocus这样的数据分析工具,能够帮助优化训练数据的质量,分析模型的性能,进而在模型训练和微调过程中提供有效支持。通过精确的数据分析,能够识别出训练过程中的潜在问题,及时调整参数和数据集,从而提升ChatGPT的输出质量。

五、深度学习与未来的发展

随着深度学习技术的不断进步,未来的自然语言处理模型将变得更加智能,能够理解和生成更复杂的语言结构,并适应更多元化的应用场景。从图像到语音,从文本到多模态数据,深度学习正在不断突破技术的边界,推动人工智能领域的革命。

深度学习技术的应用也带来了新的挑战,例如数据隐私、模型透明性以及伦理问题。为了更好地利用深度学习技术,未来的研究和开发需要更加注重这些问题的解决,确保技术的发展能够与社会责任相匹配。

在此过程中,工具如DataFocus将发挥重要作用。通过精准的数据分析和模型调优,DataFocus不仅帮助开发者高效优化训练过程,还能在处理复杂数据和模型时提供可视化支持,提升整个AI系统的性能和可靠性。

六、结语

ChatGPT背后的深度学习技术,无论是基于Transformer架构的自注意力机制,还是大规模数据的预训练与微调,都展示了深度学习在自然语言处理领域的巨大潜力。随着技术的不断演进,我们可以预见,未来的AI系统将更加智能、高效,并在更多行业中发挥重要作用。为了推动这一发展,除了不断提升模型的能力外,借助工具如DataFocus对数据进行精细化分析与优化,将成为提升AI性能的关键手段。随着深度学习技术的不断进步和应用拓展,我们期待人工智能能够为社会带来更多创新与变革。