探秘ChatGPT的核心实现原理

随着人工智能技术的飞速发展,ChatGPT作为一款领先的自然语言处理(NLP)模型,已经在多个行业中广泛应用。从日常生活的智能助手到专业领域的技术支持,ChatGPT的成功不仅源于其强大的语言理解能力,还得益于其背后深厚的技术原理。本文将深入探讨ChatGPT的核心实现原理,并结合目前的人工智能发展趋势,分析其实现背后的技术框架,帮助读者全面了解这一前沿技术的工作机制。通过对ChatGPT的结构与训练方法的细致分析,本文还将探讨如何结合产品“DataFocus”优化数据处理与分析,提高AI系统的整体性能。

ChatGPT的基础原理

ChatGPT的核心架构基于GPT(Generative Pretrained Transformer)模型,这是一种基于深度学习的自然语言生成技术。GPT属于变换器(Transformer)架构,这种架构在2017年由Vaswani等人首次提出,并迅速成为NLP领域的主流技术。Transformer模型的核心优势在于其能够处理序列数据,并通过自注意力机制(self-attention)捕捉数据中的长距离依赖关系。与传统的循环神经网络(RNN)相比,Transformer架构能够更高效地并行计算,从而极大地提高了处理速度。

预训练与微调:ChatGPT的训练过程

ChatGPT采用了预训练和微调的训练方式。预训练阶段,模型通过海量的文本数据学习语言的基本规则、语法结构以及常见的语言模式。这个过程不依赖于特定的任务,目标是让模型能够理解和生成多种类型的文本。通过无监督学习,ChatGPT能够从大规模数据集中提取语言的统计特性,为后续的任务定制化提供坚实的基础。

在微调阶段,ChatGPT会利用具体任务的标注数据进行细化调整。通过监督学习,模型学习如何更好地响应特定的输入。例如,通过对话数据集的微调,ChatGPT能够生成更加符合人类对话习惯的回答。微调不仅仅是调整模型的参数,它还涉及到如何设计高质量的训练数据,确保生成的内容在准确性、流畅性和合理性方面达到较高水平。

自注意力机制:理解上下文关系

在GPT架构中,最关键的创新之一就是自注意力机制(Self-Attention Mechanism)。自注意力机制的作用是允许模型在生成每个单词时,能够考虑输入序列中的所有单词之间的关系。通过这种机制,模型不仅仅局限于相邻的词汇,还能捕捉到文本中更广泛的上下文信息。

例如,当我们输入一个复杂的句子时,ChatGPT会通过自注意力机制自动分析各个词之间的依赖关系,确定每个词对整体语义的贡献。在理解问题时,这种机制让ChatGPT能够根据上下文信息灵活调整生成的回答,使其不仅准确而且自然。

模型规模与计算能力:深度学习的挑战

ChatGPT模型的成功离不开强大的计算能力。在实际应用中,GPT模型往往包含数以亿计的参数。随着参数规模的增加,模型的理解能力和生成能力也显著提高。训练和运行如此大规模的模型对计算资源提出了极高的要求。为了保证模型的高效运行,AI公司需要使用大规模的分布式计算平台,同时采用高效的优化算法来提高计算效率。

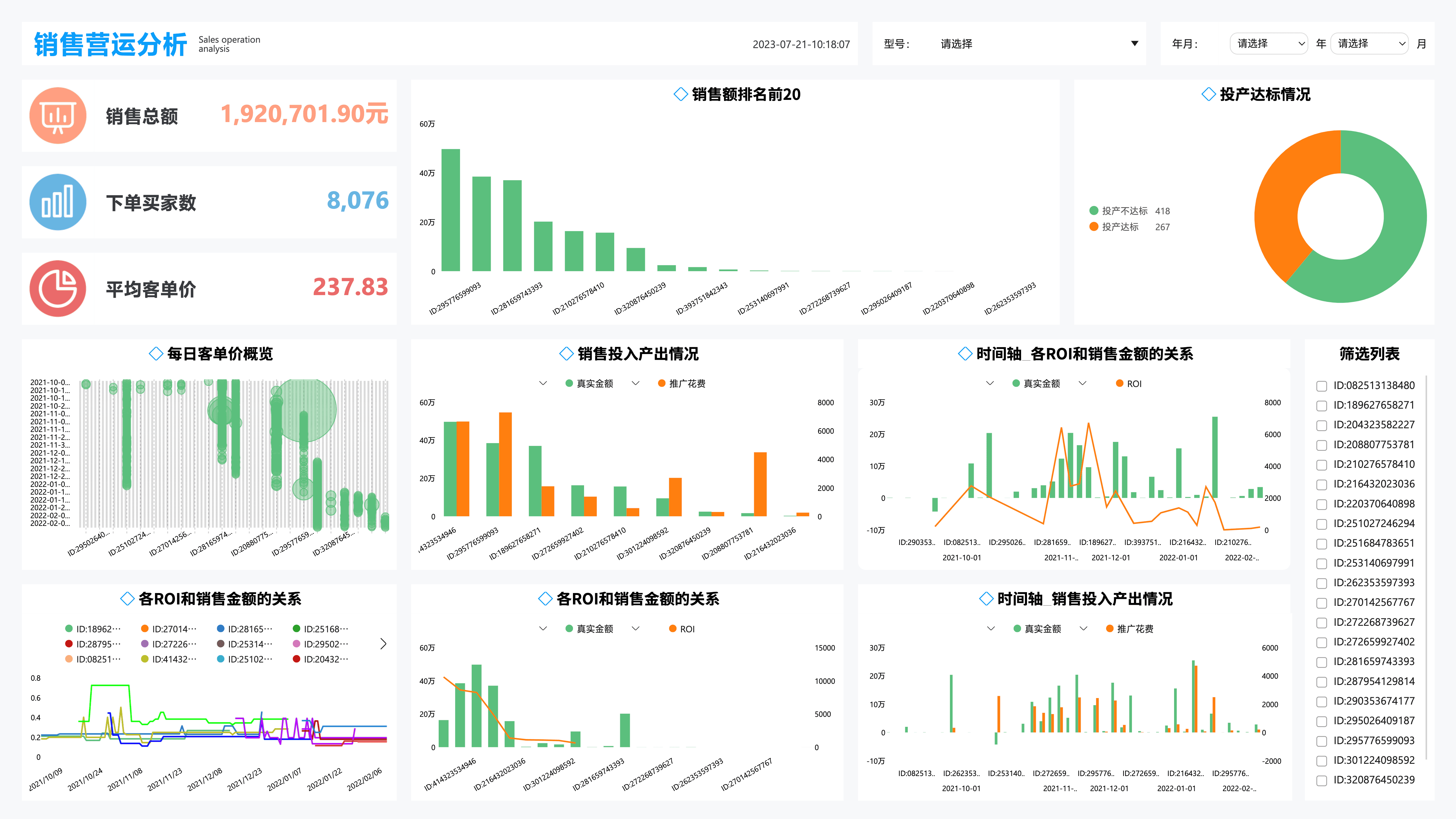

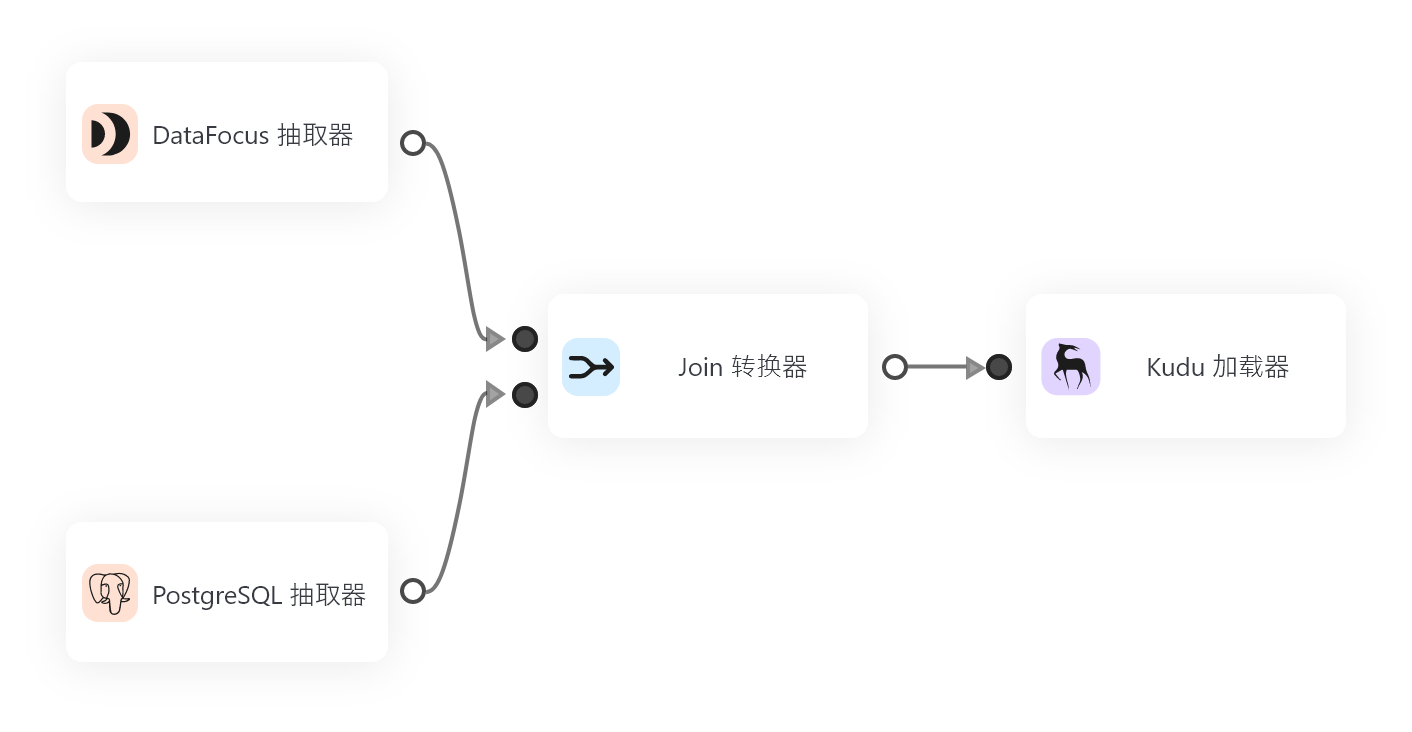

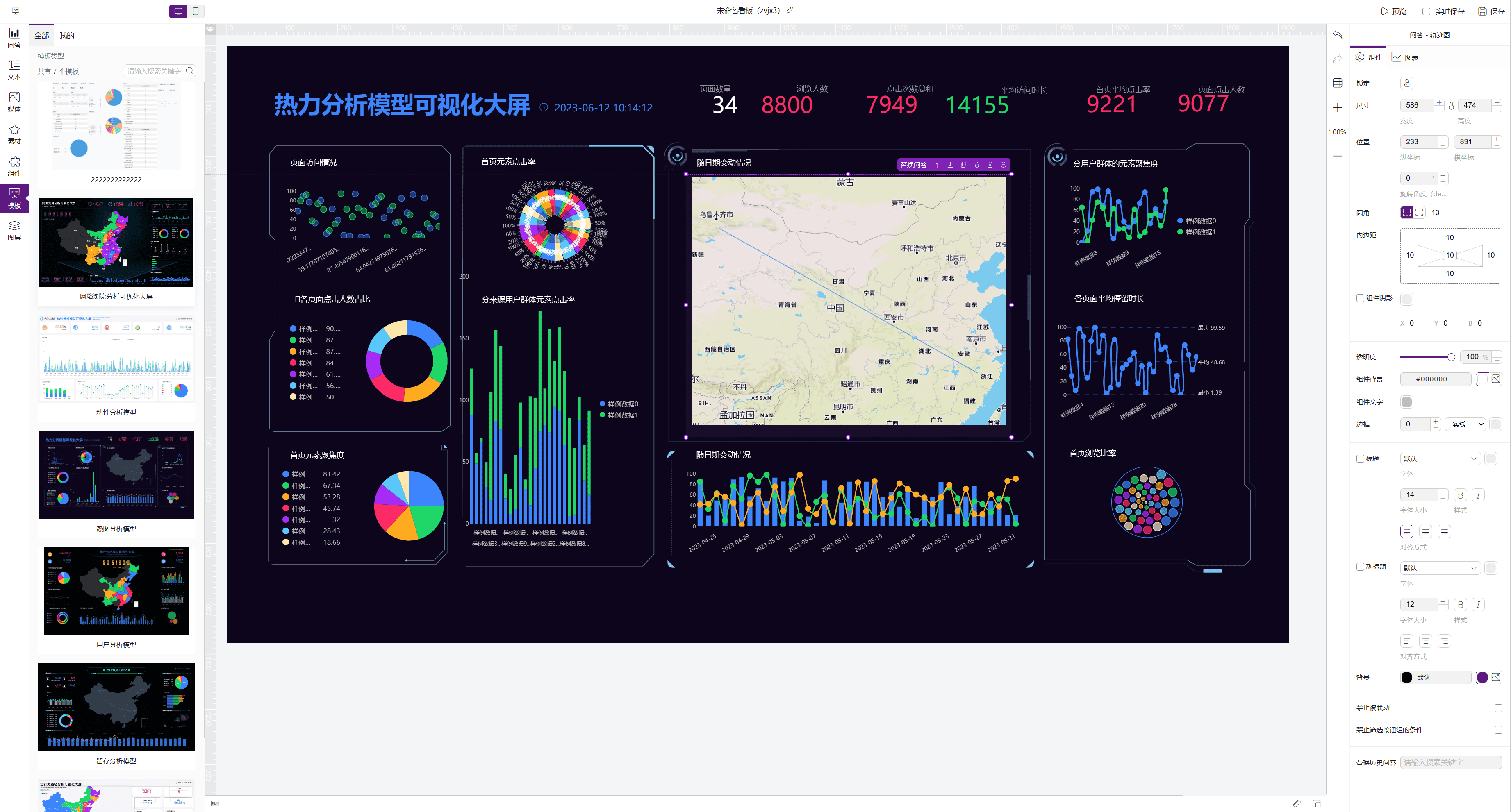

在这一过程中,DataFocus等数据处理和分析产品提供了重要支持。DataFocus的强大数据分析能力使得在大规模数据集上进行模型训练时,能够更高效地处理和筛选有效数据,提升训练效果。通过对训练数据的精准管理和优化,DataFocus帮助AI公司减少了冗余数据的干扰,使得模型训练更具针对性。

ChatGPT的应用场景

ChatGPT的应用范围已经涵盖了从智能客服、自动写作、到语言翻译等多个领域。其生成式的对话能力使其能够在实际应用中展现出出色的灵活性。特别是在自然语言生成(NLG)方面,ChatGPT已经能够通过上下文推理生成符合逻辑且富有创意的内容。随着AI技术的进步,ChatGPT还被广泛应用于教育、医疗、金融等专业领域,在提升效率的降低了人工成本。

随着ChatGPT的应用不断扩大,如何保证其生成内容的质量与准确性,以及如何管理大量用户数据的隐私问题,成为了亟待解决的挑战。在这方面,DataFocus凭借其高效的数据处理能力,能够帮助企业在保障数据安全的前提下,优化模型的训练和应用效果,确保AI系统的可靠性与合规性。

持续改进与未来展望

尽管ChatGPT已在多个领域取得了显著的成绩,但其技术仍在不断进步中。未来,随着计算能力的提升和算法的优化,ChatGPT有望在更复杂的任务中展现出更强的性能。模型的精细化训练和多模态学习(如文本、图像和声音的结合)也将成为未来发展的重要方向。

在这一过程中,产品如DataFocus将继续发挥重要作用。通过对大量数据的深度挖掘与智能分析,DataFocus不仅能提升模型的训练效率,还能为ChatGPT提供更丰富、更高质量的数据支持,为其进一步提升智能化水平提供保障。

专业总结

ChatGPT的核心实现原理不仅仅依赖于深度学习算法的创新,还得益于其背后强大的数据处理能力和高效的计算架构。通过自注意力机制、预训练与微调的策略,ChatGPT在语言生成的准确性和流畅性方面取得了显著突破。未来,随着技术的不断演进,ChatGPT将继续在更多行业中发挥其重要作用,而像DataFocus这样的数据处理产品,将为AI技术的持续优化和应用推广提供坚实的支撑。