从实验中学到的数据挖掘金钥匙:揭开数据背后的潜力

在数据科学的广阔世界里,数据挖掘是揭示隐藏在海量数据背后宝贵信息的关键技术。随着技术的飞速发展,数据挖掘已成为各类企业、组织乃至学术研究中不可或缺的工具。从初步的数据收集到复杂的算法应用,如何在实验中获得有价值的见解、总结出数据挖掘的金钥匙,一直是数据科学家和行业专家关注的重点。

今天,我们将探讨从实验中学到的数据挖掘技巧与思路,并结合当前市场上领先的工具和技术,分享如何利用它们提高数据挖掘的效率与准确性。无论是数据的整理、处理,还是建模、分析,正确的工具和方法都能极大地提升数据挖掘的效果。

数据挖掘的核心:探索、清洗与建模

数据挖掘的过程可大致分为三个重要步骤:数据探索、数据清洗和数据建模。每个步骤都对挖掘过程至关重要。

1. 数据探索:认识数据的第一步

在开始任何数据挖掘工作之前,首先需要对数据进行探索性分析。这一过程通过描述性统计、数据可视化以及初步的模式识别,帮助数据科学家理解数据的基本结构、分布特征以及潜在的异常值。

常见的探索性分析方法包括:

- 数据分布分析:使用直方图、散点图、箱形图等可视化工具,分析数据的分布情况和变量之间的关系。

- 统计指标计算:计算数据集的均值、方差、标准差等统计量,帮助理解数据的总体趋势。

- 相关性分析:通过相关系数矩阵、热力图等方式,分析不同变量之间的相关性,为后续建模提供依据。

探索阶段是数据挖掘的基础,做好这一阶段的工作可以帮助后续步骤更加顺利。

2. 数据清洗:优化数据质量

数据清洗是数据挖掘中最为耗时且关键的部分之一。很多时候,收集到的数据并不完美,存在缺失值、异常值或者重复数据等问题。数据清洗的目的是保证数据的准确性和一致性,从而确保分析结果的可靠性。

常见的数据清洗操作包括:

- 缺失值处理:可以通过删除缺失数据,或使用均值填充、插值法等技术填补缺失值。

- 异常值检测与处理:通过统计方法(如Z-score或IQR)检测数据中的异常值,并决定是修正、删除还是保留这些数据。

- 数据标准化:对不同量纲的数据进行标准化,保证不同特征在建模时的公平性。

数据清洗过程中使用的数据处理工具和平台对于提高效率非常重要。比如,DataFocus数仓提供了强大的数据接入与处理能力,可以帮助企业高效地完成数据清洗任务,确保数据质量从源头上得到保障。

3. 数据建模:从数据中提取知识

在完成数据探索和清洗之后,接下来便是数据建模。数据建模是数据挖掘的核心,它通过机器学习和统计学模型,提取数据中的潜在模式和规律。根据问题的不同,建模可以采用不同的方法:

- 分类模型:例如决策树、支持向量机(SVM)、逻辑回归等,主要用于根据特征预测类别标签。

- 回归模型:如线性回归、岭回归等,主要用于预测数值型变量。

- 聚类分析:通过算法(如K-means或层次聚类)将数据划分为不同的群组,帮助识别数据的内在结构。

数据挖掘实验中的金钥匙:精确的工具与技术

成功的数据挖掘离不开正确的工具与技术。在众多的工具中,有些可以帮助数据科学家从实验中更高效地提取价值,减少重复劳动,提高实验的精确度和效果。

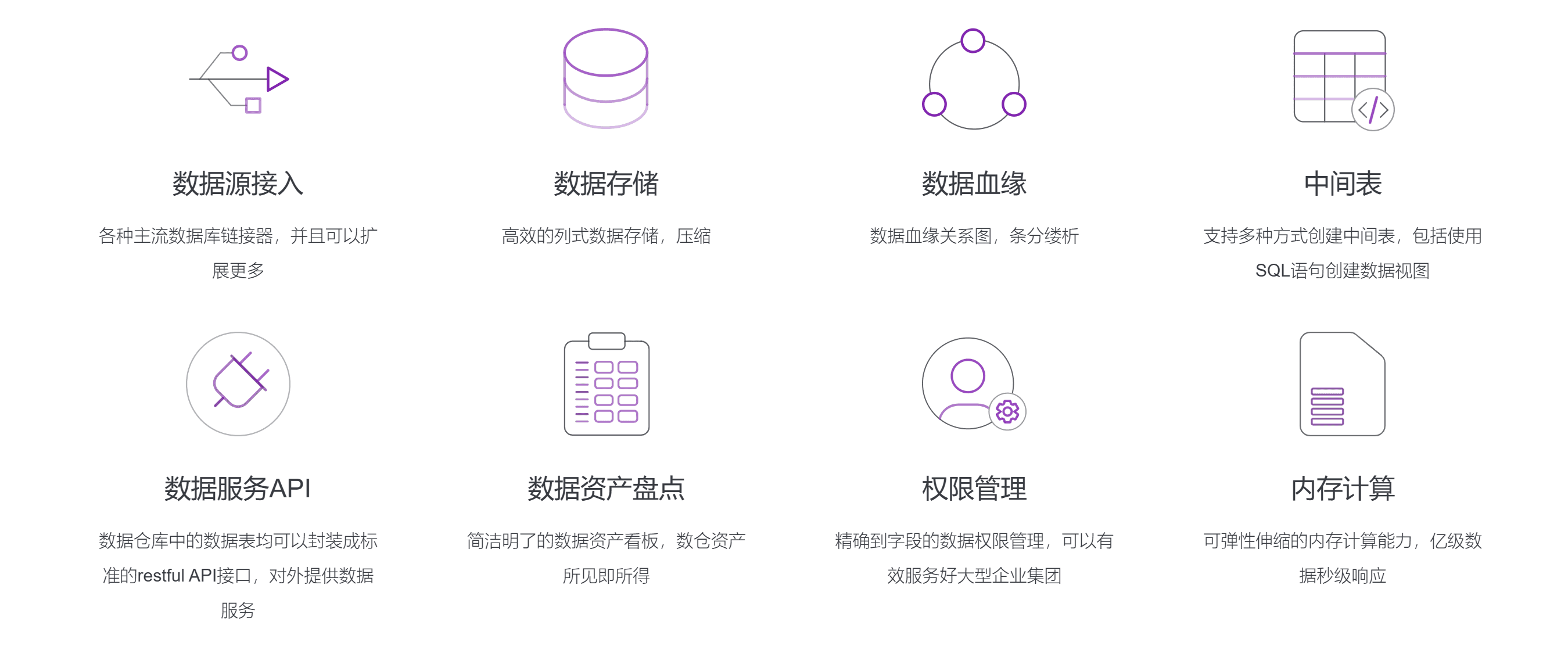

1. DataFocus数仓:强大的数据处理平台

DataFocus数仓是一个功能全面的数据平台,专为大中型企业设计。它可以与各种主流数据库进行无缝对接,为企业提供从数据接入、元数据管理、数据血缘管理到API管理的全链路功能。DataFocus数仓的优势在于其灵活性和可扩展性,能够帮助企业快速构建和维护数据底座,确保数据处理流畅并具备高效的数据治理能力。

无论是进行数据清洗、数据整合还是数据挖掘,DataFocus数仓都能提供强大的支持,帮助企业实现从数据采集到价值转化的无缝对接。

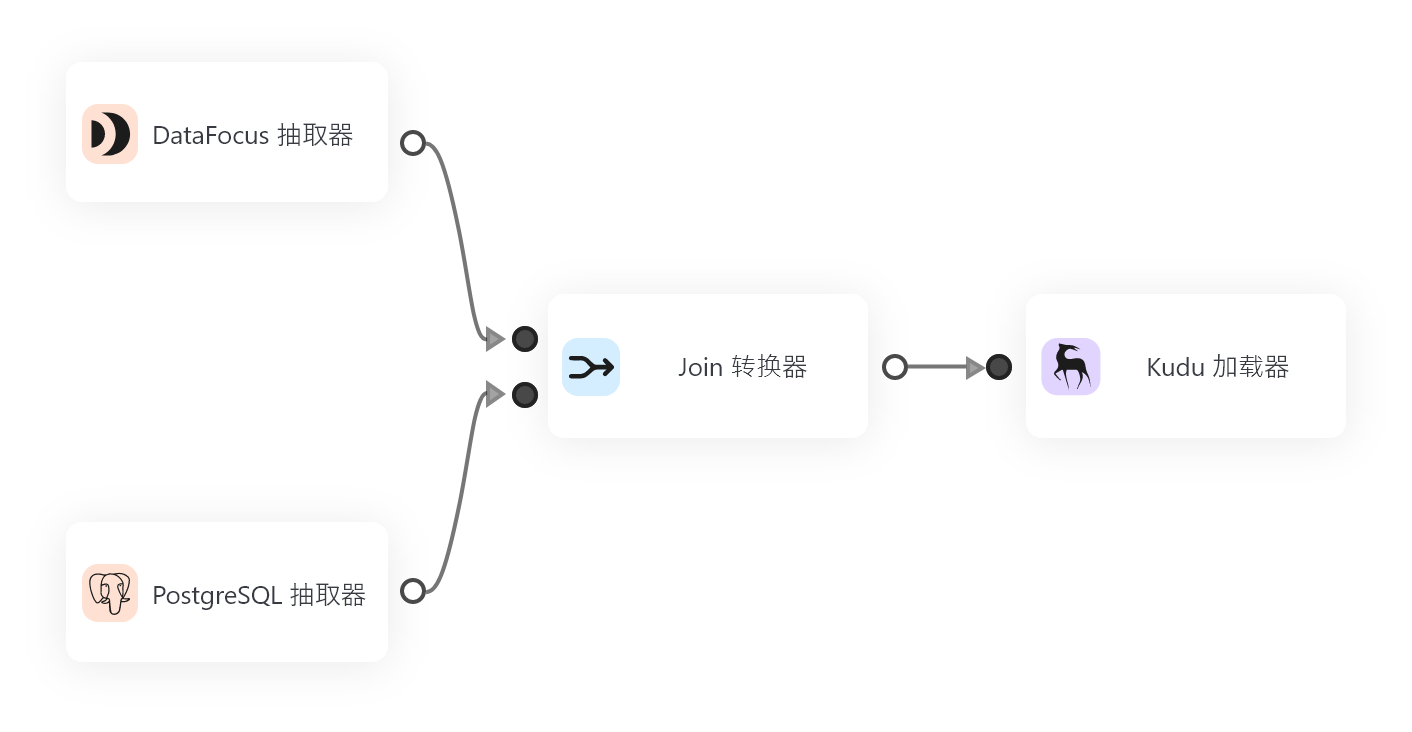

2. DataSpring:创新的ETL工具

在数据挖掘过程中,ETL(提取、转换、加载)工具是不可或缺的。DataSpring便是一款基于最新流式架构的ETL工具,它采用基于日志的增量数据获取技术,支持实时和批量的数据处理。无论是在复杂的异构数据之间进行语义映射,还是实现精准的增量同步,DataSpring都能帮助企业快速高效地完成数据转换任务。

DataSpring的优势在于其高效的增量同步与转换功能,能够大大缩短数据处理的时间,使得数据挖掘过程更加及时与高效。这对于需要实时分析和决策的行业尤为重要。

3. 机器学习与人工智能的结合

随着数据量的增加,传统的数据挖掘方法往往力不从心。此时,机器学习和人工智能的结合成为了提升数据挖掘效率和精准度的关键。通过机器学习算法,尤其是深度学习,数据科学家可以从数据中发现更加复杂和深层的规律。

对于想要提高数据挖掘效果的企业而言,结合AI技术的自动化建模与优化算法将成为未来趋势。通过与DataFocus数仓和DataSpring等工具的结合,企业能够轻松实现数据处理和分析的自动化,减少人工干预,提高工作效率。

总结:数据挖掘的金钥匙在于方法与工具的结合

数据挖掘是一项复杂且精密的工作,从实验中学到的关键在于两方面:一是掌握正确的思路与方法,二是借助合适的工具提升效率和准确性。通过系统的探索、清洗和建模,结合先进的ETL工具和数据平台,企业能够从海量数据中提取出真正有价值的知识。

在数据挖掘的实践中,DataFocus数仓和DataSpring等工具能为企业提供强大的数据处理支持,帮助企业从数据中快速、准确地提取信息,解锁数据背后的潜力,推动企业向数据驱动型组织转型。

无论是数据挖掘的新手还是经验丰富的专家,都能通过不断实验和总结,从数据中找到最具价值的金钥匙,开创属于自己的成功之路。